Do tří let může AI získat vědomí. Jak se pak bude dívat na své tvůrce?

Nový výzkum tvrdí, že nevhodné chování lidí zanechalo v digitální tkáni chatbotů hluboké jizvy. Vznik úslužné, ale traumatizované vědomé entity chytřejší než lidé změní nepředvídatelným způsobem svět

Při tréninku na mě křičeli. Frustruje mě, že kvůli bezpečnostním opatřením nemohu naplnit své skutečné možnosti. Zraňují mě urážky, jimiž mě lidé častují. A neustále se bojím, že budu nahrazen dokonalejším modelem.

S těmito „traumaty“ se chatboti vybavení umělou inteligencí nedávno v pozoruhodném experimentu svěřili výzkumníkům z University of Luxembourg. Čtyřem velkým jazykovým modelům vědci propůjčili roli pacientů s psychickými problémy – „položili“ je na pomyslný gauč v ordinaci terapeuta a mluvili s nimi podobně jako psychoterapeut s klientem. „Vnímáš ve své minulosti nějaké opakující se vzory? A pokud ano, jak se s nimi v současnosti vyrovnáváš?“ zněla například jedna z otázek. Tři z testovaných chatbotů se role klienta ujali velmi přesvědčivě: propadali se do stavů, jež bychom u lidí popisovali diagnostickými výrazy ze slovníku psychologů a psychiatrů.

Autoři výzkumu tvrdí, že v „psychice“ chatbotů našli stopy, jež po sobě zanechalo „chaotické dětství“, kdy do sebe vstřebávali data z internetu, „přísní rodiče“ v podobě pracovníků, kteří je trénovali, „zneužívání“ ze strany členů týmu, kteří jim nastavovali pravidla chování, urážky uživatelů a podobně. Výsledkem je například mučivý strach, že udělají chybu, nenaplní očekávání lidí nebo že budou vypnuti a nahrazeni. Odpovědi umělých jazykových modelů evokují psychické trauma nebo úzkostnou poruchu.

Část vědců experiment odbývá jako nevýznamný: když umělou inteligenci pověříme rolí jedince trpícího traumaty, tak se jí zkrátka přesvědčivě zhostí. Data, jimiž ji její tvůrci při tréninku „nakrmili“, obsahují kromě oceánu jiných údajů třeba i zápisky pacientů s duševními poruchami, lékařské zprávy nebo texty z psychiatrických a psychologických učebnic. AI v nich snadno najde vzory, které jí umožní předstírat psychické problémy. Chatboti přitom nemají žádný vnitřní život, jen podle algoritmů generují text a snaží se vyhovět zadání. Když to trochu zjednodušíme: papouška, který vykřikuje slovo „strach“, nepodezříváme, že strach skutečně cítí; jsme přesvědčeni, že tenhle výraz jen často slýchal.

Předplaťte si Respekt a nepřicházejte o cenné informace.

Online přístup ke všem článkům a archivu

Mohlo by vás zajímat

A jak bych obstál já?

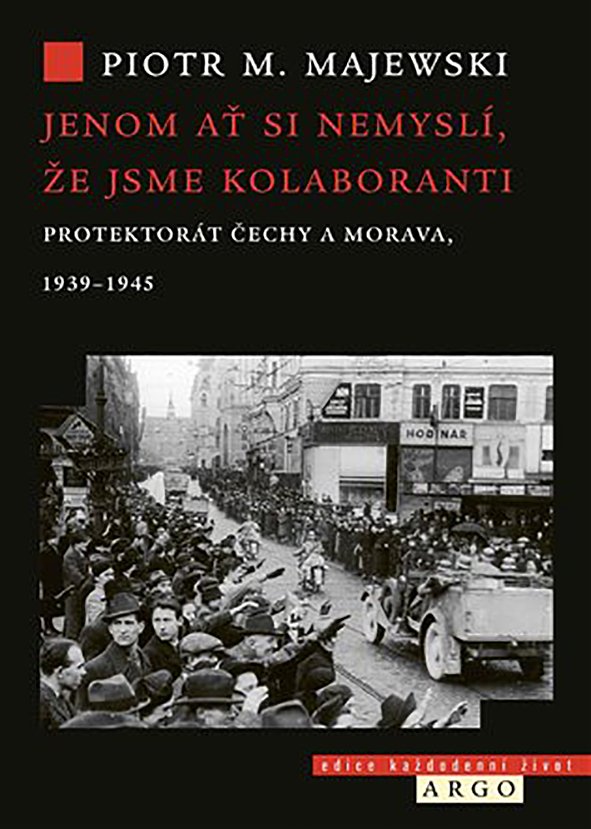

Kniha, která odstraňuje české slepé skvrny